OpenAI公布了无向量化RAG(检索增强生成)问答系统新范式,通过模拟人类阅读和思考方式实现高效知识问答,无需复杂的向量化过程。文章深入剖析了该架构设计,并以法律知识问答为例详细阐述了四大核心环节。同时,探讨了通用大模型选择策略,展示了AI智能体系统在实际应用中的构建方法,包括模型选择、工具集成、从原型到生产的考量等,为构建下一代AI智能体应用提供了实践指南。

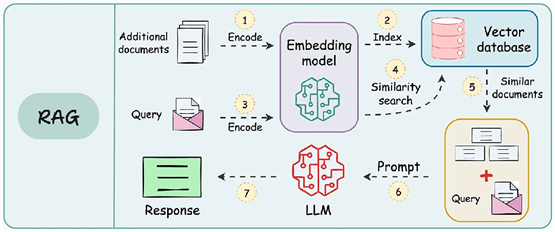

AI 应用在企业中落地越来越多了,特别是帮助用户从海量文档中迅速找到所需信息并提供答案,这些应用在技术上往往会使用到 RAG(检索增强生成),RAG 技术是构建这类系统的主要选择。然而,传统 RAG 技术往往需要复杂的向量化过程,这不仅增加了开发难度,也限制了系统的效率和可扩展性。

最近,OpenAI 公布了一个令人眼前一亮的 RAG 问答系统架构设计新范式。这一系统同样基于 RAG 技术,但却完全摒弃了向量化步骤,实现了技术上的重大突破。那么,它是如何做到这一点的呢?本文将深入剖析这一创新案例,并进一步探讨通用的大模型选择策略,帮助你在实际应用中构建出更高效、更智能的 AI 智能体系统。

下文我们详细剖析之。

—1—

OpenAI RAG 架构设计新范式剖析

1、无向量化 RAG 架构设计新理念

RAG 技术的核心目标是解决大语言模型(LLM)在处理特定领域知识时的局限性,比如“失忆”问题或者长文本处理的高昂成本。比如:如果你要为自己的公司搭建一个智能客服系统,大模型本身是不知道你们公司的产品细节的。如果把一本厚厚的、长达 1000 页的产品手册全部塞进大模型里,不仅成本高得吓人,而且大模型还可能因为信息量太大而“记不住重点”。RAG 技术的出现,就是为了攻克这个难题:它可以从海量文档中精准地筛选出与用户问题最相关的内容(比如:在 1000 页手册里,可能只有三段话是关键信息),然后把这部分精炼的信息和用户的问题一起交给大模型,让大模型基于这些相关的信息给出准确的回答。这种“先筛选关键信息,再基于这些信息回答问题”的模式,正是 RAG 的核心优势。

传统的 RAG 技术大多依赖向量化,即把文本转换成数字向量,通过计算向量之间的相似度来找到相关内容。但 OpenAI 的新方案却打破了常规,它采用了一种零向量化的 Agentic

RAG 方法,其核心是模拟人类阅读和思考的方式,让系统像人一样去理解和筛选信息。

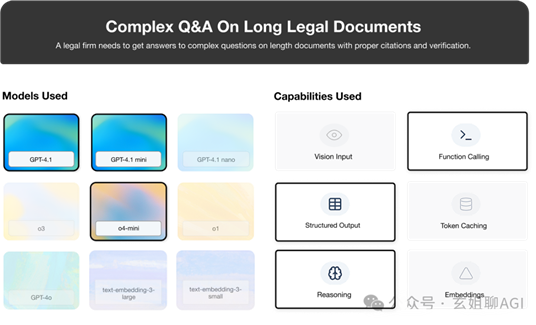

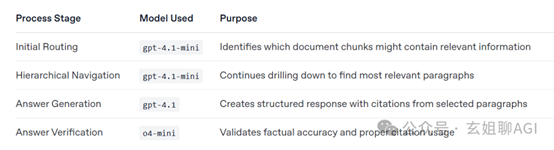

2、无向量化 RAG 新架构设计剖析(以法律知识问答为案例)

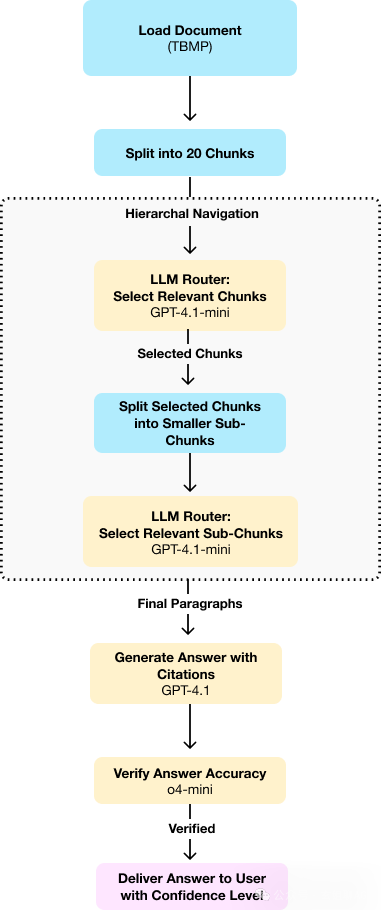

OpenAI 无向量化 RAG 新架构设计由四大核心环节构成,以下以法律知识问答为案例来详细剖析之。

第一、文件加载 (Document

Loading)

系统首先加载一份长达 1000 多页的 PDF 格式法律文件( 比如:《商标审判和上诉委员会程序手册 TBMP》)。它会提取文本内容,但为了避免超出 GPT-4.1-mini 模型 100 万 Token 的上下文窗口限制,系统只读取前 920 页,这部分内容刚好在大模型可处理范围内。

第二、内容切割与挑选(层次化导航)(Hierarchical

Navigation)

这是整个流程最具创新性的环节,模拟人类“从粗到细”的阅读方式,系统会进行多轮迭代:

·

初始粗切:将整个法律内容切分为 20 个大块。

·

模型路由:将这些大块和用户问题一起发送给

GPT-4.1-mini 模型。该大模型基于其强大的自然语言理解能力,识别出哪些大块可能包含相关信息。选择

GPT-4.1-mini 是因为其巨大的上下文窗口(100 万

Token)和较低的成本,非常适合处理大量文本的初步筛选。

·

逐层钻取:在后续轮次中,大模型会对上一轮挑选出的相关内容再次进行细致切割(比如:每个选定块再切分 3 份),然后再次让大模型挑选,如此往复,直到找到与用户问题最相关的段落级别内容。这种迭代方式比一次性将文档切成数百份并让大模型挑选的效果更好,因为切得太细碎反而可能让大模型感到混乱。

·

思考板(Scratchpad):在内容挑选过程中,系统会要求大模型在选择前必须进行思考,并将思考过程存储在“思考板”中。这个思考板的内容会带到下一轮,不仅提高了挑选的准确率,还使得大模型的决策过程可追溯和可调试,极大地增强了系统的透明度。

第三、生成答案 (Answer

Generation)

一旦确定了与用户问题最相关的几个段落,系统会将其与用户问题一起打包,发送给 GPT-4.1 大模型来生成初步答案。选择 GPT-4.1 是因为在这个环节中,答案的准确性至关重要,而 GPT-4.1-mini 模型“胡说八道”的概率会大很多。此外,由于此时输入大模型的文本量已经大大减少,成本控制的需求也不再像内容挑选阶段那样强烈。

· 强制引用:为了确保答案的可验证性和溯源性,系统采用了一个巧妙的“字面量列表(List

of Literals)”技巧,强制大模型只能引用提供的特定段落 ID。这意味着大模型不会凭空捏造引用或随机高亮文本,而是必须将其回答中的每句话都与精确的源材料(比如:“0.0.5.0”等)关联起来。这对于法律问答这类对准确性和可追溯性要求极高的场景至关重要。

第四、答案验证 (Answer

Verification)

答案生成后,系统并不会立即将其返回给用户,而是会进行答案验证:

·

LLM-as-Judge:系统会将大模型的初步回答、用户问题以及引用的段落内容,一同发送给 O4(或 O4-mini)大模型进行验证。O4 大模型推理能力极强,非常适合判断答案是否基于引用内容回答、是否存在“胡说八道”的情况。

·

信心评估:验证结果不仅包含通过与否,还会给出大模型对答案准确性的信心值(如“高”、“中”、“低”),这为答案质量提供了额外的质量保障。

通过以上四个核心环节,OpenAI 的无向量化 RAG 系统在法律知识问答领域实现了高效、准确且可追溯的智能问答,为用户提供了可靠的解决方案。

3、无向量化 RAG 新架构设计的优劣与成本考量

这种创新的 RAG 架构设计新方案带来了显著的优势,但也伴随一些权衡:

第一、优势 (Benefits)

·

零摄入延迟:新文档可以立即用于问答,无需任何预处理或维护向量数据库。

·

动态导航:通过模仿人类阅读模式,能更灵活地处理复杂文档,理论上准确率更高。

·

跨章节推理:大模型能够发现文档不同部分之间的关联,避免传统

RAG 因分块过小而可能错失的联系,提高了答案的准确性。

·

无需额外基础设施:整个系统只需通过 API 调用即可构建,无需向量数据库等额外基础设施维护。

第二、劣势 (Tradeoffs)

·

单次查询成本较高:每次查询需要更多计算,导致成本比基于向量嵌入的传统 RAG 高。比如:一次查询的成本约为 0.36 美元。

·

查询时间更长:层次化导航过程比简单的向量查找需要更长的处理时间,增加了延迟。

·

可扩展性有限:对于极其庞大的文档集合,传统预处理(比如:向量化)可能仍然更高效。

第三、适用场景

尽管存在上述权衡,对于那些对即时性、答案精确性、可溯源性和无需维护复杂基础设施有高要求的场景(比如:法律、医疗合规、金融法规或技术文档),这种 Agentic RAG 方法无疑是一个强大的解决方案。

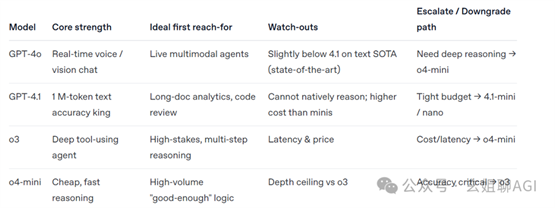

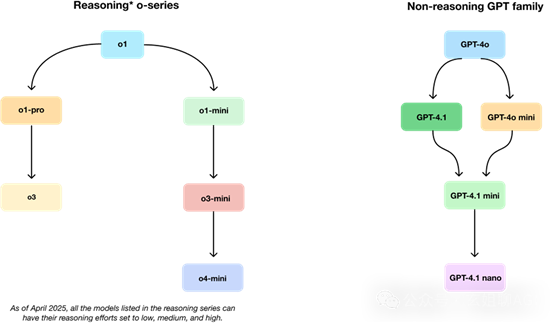

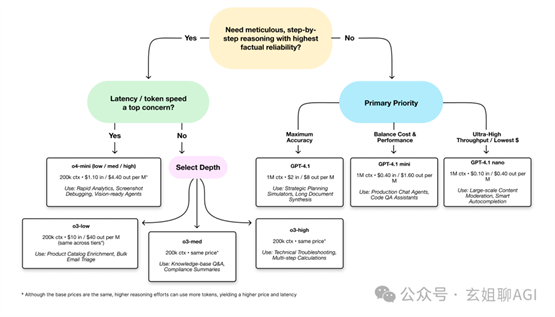

4、通用大模型选择智慧:构建多模态、多 AI 智能体系统

OpenAI 的实践案例不仅展示了创新的 RAG 技术,还蕴含着通用的大模型选择和组合智慧。OpenAI 的模型大致可分为两大家族:

第一、GPT 模型(比如: GPT-4.1, GPT-4o)

·

特点:通常针对通用任务进行优化,擅长指令遵循和长上下文处理。

·

应用场景:适用于需要处理大量文本和生成通用内容的场景。

o 系列模型(比如: o3, o4-mini)

·

特点:专为深度推理和多步问题解决而设计,擅长复杂、多阶段任务和工具使用。

·

应用场景:适用于需要深度分析和多步推理的复杂任务。

第二、核心洞察

分层方法:使用更快速、更廉价的大模型进行广度和初步筛选,然后将任务升级到更强大、更精确的大模型进行深度分析、批判性审查和最终生成。这种分层方法能在保持创意和速度的同时,兼顾严谨性和准确性,并有效管理计算成本。

第三、实际案例剖析

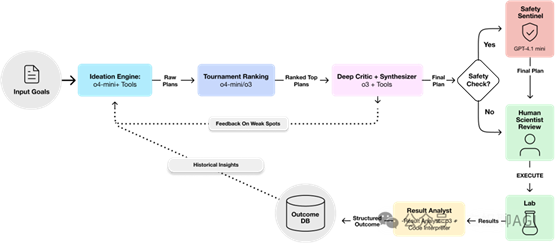

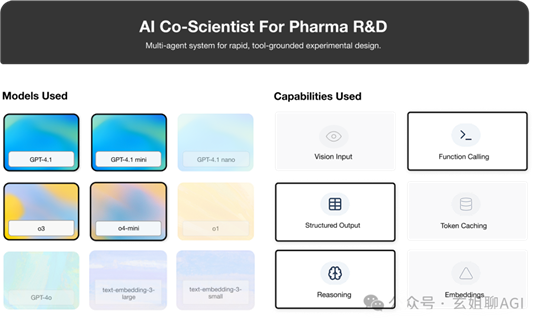

4.1、 AI 辅助制药研发(AI Co-Scientist for Pharma R&D)

该系统模拟了一个高效的科研团队,具体步骤如下:

·

构思阶段:使用多个 o4-mini 实例(扮演“假设 AI 智能体”、“方案 AI 智能体”等不同角色)并行生成实验方案,充分发挥其速度和成本优势,同时利用外部工具调用(比如:化学数据库、成本估算器)将方案与真实数据结合。

·

排名阶段:o4-mini 或 o3 对生成的方案进行配对比较,而非孤立评分,以获得更可靠的相对排名。

·

深度批判与合成:将排名前列的方案交给 o3 进行严格审查,o3 扮演“资深科学家”,评估科学有效性、方法论、安全性和预算合规性,并提出改进意见。将构思与批判分离,并使用不同的模型,能有效避免模型自我辩护,提高客观性。

·

安全检查(可选):GPT-4.1-mini 可进行最后的特定安全风险检查。

·

人类审查与学习:最终方案由人类科学家审查批准,实验结果反馈给

o3 结合 Code Interpreter 进行分析,形成学习闭环。

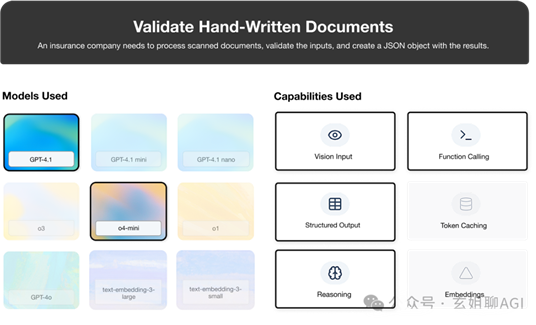

4.2、保险理赔表单处理(Insurance

Claim Processing)

该方案旨在数字化和验证手填保险表单,具体步骤如下:

·

第一阶段(OCR):利用 GPT-4.1 强大的视觉(Vision)和 OCR 能力,以最高准确率从图像中提取文本,并将不确定性(比如:模糊的字符、缺失的字段)传递给下一阶段。

·

第二阶段(推理与验证):利用 o4-mini 的推理能力来验证 OCR 结果的准确性,并使用函数调用(Function Calling)来解决不确定性,例如通过 validate_email 工具验证邮件地址,或通过 search_web 工具推断缺失的邮编和县名。o4-mini 在这里提供了经济高效的推理能力。

·

结构化输出:整个过程使用 Pydantic 模型定义数据结构,确保输出格式的一致性和易用性。

·

思维链(Chain-of-Thought):大模型在处理过程中会产生思维链总结,这有助于理解大模型的推理过程,并在开发中发现潜在的架构问题。

第四、关键技术应用

这些案例共同展示了以下关键技术在复杂多步 AI 智能体系统中的应用:

·

结构化输出:确保数据格式的一致性和易用性。

·

工具集成:利用外部工具调用提升任务处理能力。

·

思考板/思维链:记录大模型的推理过程,便于调试和优化。

·

角色扮演:不同大模型扮演不同角色,提高任务处理的灵活性。

·

LLM 作为评判者:利用强大推理能力的模型进行验证和评估。

通过这些实践案例,OpenAI 展示了如何通过合理选择和组合不同模型,实现高效、准确且经济的 AI 智能体系统设计。

5、从原型到生产的考量

将 AI 智能体系统从原型阶段过渡到生产环境,需要细致的规划和执行。以下是需要重点关注的领域:

1. 定义成功标准

·

明确可衡量的 KPIs 和 SLOs:比如:RAG 准确率、OCR

成本、P95 延迟等,确保这些指标能够量化系统性能和业务目标的达成情况。

2. 文档化模型选择理由

·

记录选择特定大模型的理由:包括成本、延迟和能力权衡,以便于未来的更新和团队协作。详细记录这些决策过程,可以帮助团队成员快速理解系统设计的初衷和限制。

3. 稳健的评估与测试

·

建立自动化测试套件和“黄金数据集”:持续评估模型的事实准确性、幻觉率、工具错误率,并进行边缘案例测试。通过自动化测试确保模型在各种场景下的稳定性和可靠性。

4. 可观测性与成本控制

·

实施全面的日志记录:跟踪 Token 使用量、大模型延迟和查询成本,并设置成本控制措施(比如:最大 Token 限制、不同运行模式)。通过监控这些指标,可以及时发现潜在问题并优化系统性能。

·

成本控制措施:比如:设置最大 Token 限制,避免不必要的资源浪费,同时根据不同的运行模式(比如:开发、测试、生产)调整资源配置。

5. 安全性与合规性

·

利用 OpenAI 的审核 API 和安全系统提示:强制人类介入(Human-in-the-Loop, HITL)审查低置信度或高风险的输出,并确保符合行业特定法规。通过这些措施,可以有效降低安全风险并确保系统的合规性。

6. 大模型更新与版本管理

·

制定版本锁定策略:确保大模型的稳定性和一致性。

·

A/B 测试框架:通过 A/B 测试评估新大模型版本的性能,确保改进是有效的。

·

明确的回滚程序:在出现问题时能够快速恢复到之前的版本,减少对业务的影响。

7. 与非技术利益相关者沟通

·

将技术指标转化为业务影响:突出大模型选择的权衡,并用具体示例说明价值。通过清晰的沟通,帮助非技术团队成员理解 AI 智能体系统的商业价值和潜在风险。

通过以上这些步骤,可以确保 AI 智能体系统从原型阶段平稳过渡到生产环境,同时保持系统的高效性、可靠性和安全性。

6、总结

OpenAI 的实践案例,尤其是其无需向量化的 Agentic

RAG,充分展现了大上下文窗口的强大潜力。这一创新不仅开启了高效知识问答的新篇章,更重要的是,为我们理解和构建复杂的 AI 智能体系统提供了宝贵的实践指南。

第一、大上下文窗口的潜力

· 高效知识问答:通过精准提取和处理关键信息,Agentic RAG 实现了高效的知识问答,即使在处理复杂文档时也能保持高准确率。

· 模拟人类认知:该技术通过模拟人类的阅读和思考模式,逐步筛选和分析信息,从而更接近人类的决策过程。

第二、构建复杂 AI 智能体系统的实践指南

· 战略性模型选择:通过选择不同类型的模型(比如:GPT 系列和 o 系列),并根据任务需求进行组合,可以实现更高效的任务处理。

· 深度工具集成:通过集成外部工具(比如:化学数据库、OCR 工具、函数调用等),系统能够处理更复杂的任务,同时保持灵活性和扩展性。

第三、下一代 AI 智能体应用的特点

· 强大:通过分层方法和多模型协作,系统能够处理复杂的多步任务,提供更准确的答案。

· 可靠:通过自动化测试、持续评估和安全审查,确保系统的稳定性和可靠性。

· 可控:通过成本控制、版本管理和人类介入审查,确保系统的可管理性和合规性。

· 成本效益:通过合理分配任务到不同模型,优化资源使用,降低整体成本。

通过这些实践,OpenAI 不仅展示了无向量化 RAG 的强大能力,还为构建下一代 AI 智能体应用提供了清晰的路径。这种技术不仅适用于法律、医疗、金融等领域,还可以推广到任何需要高效知识处理和复杂决策的场景。

原文出自:https://mp.weixin.qq.com/s/nUlFDxnUlEj0EG5Lg0xN_Q

本文档由网友提供,仅限参考学习,如有不妥或产生版权问题,请联系我们及时删除。

客服请加微信:skillupvip