本文介绍了使用Stable Diffusion进行高精度换脸的操作流程,包括初版换脸、精修和高精度处理三个步骤,涉及参数设置、模型选择等,并强调了面部修复的重要性。文章还提供了具体的操作步骤和示例,展示了如何通过调整参数和模型实现高精度换脸。

一、简介

最近Roop换脸插件横空出世,大家再也不用看千篇一律的AI脸了,使用这个插件的过程中很多人发现换好的脸部存在精度不够问题,今天给大家分享使用Stable Diffusion高精度换脸的操作流程,这个可以说是AI做图的必备功能之一,应用领域非常广。

二、实操案例

1.图生图示例(局部重绘)

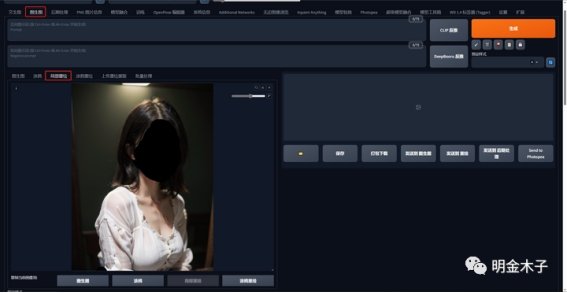

操作步骤一:初版换脸

Stable Diffusion 模型:BRA_V4_2.safetensors

外挂 VAE 模型:chilloutmix_NiPrunedFp32Fix.vae.ckpt

Lora模型:

反向tag:

CLIP 终止层数:2

正向提示词:

反向提示词:

迭代步数 (Steps):40

采样方法 (Sampler):DPM++ SDE Karras

面部修复:开启

宽度:512

高度:768

总批次数:1

单批数量:1

提示词引导系数 (CFG Scale):7

重绘幅度:0.1(根据实际情况调整)

随机数种子 (Seed):-1

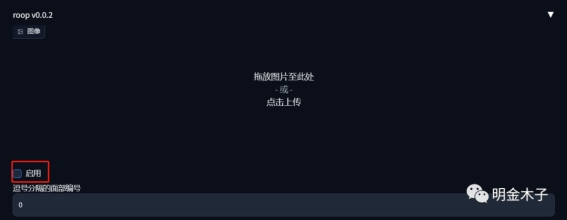

roop插件:启用 面部修复:GFPGAN 面部修复强度:0.9

初版换脸:

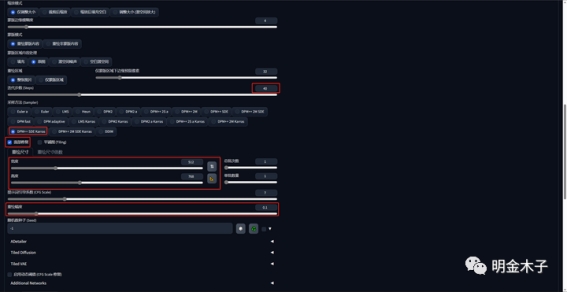

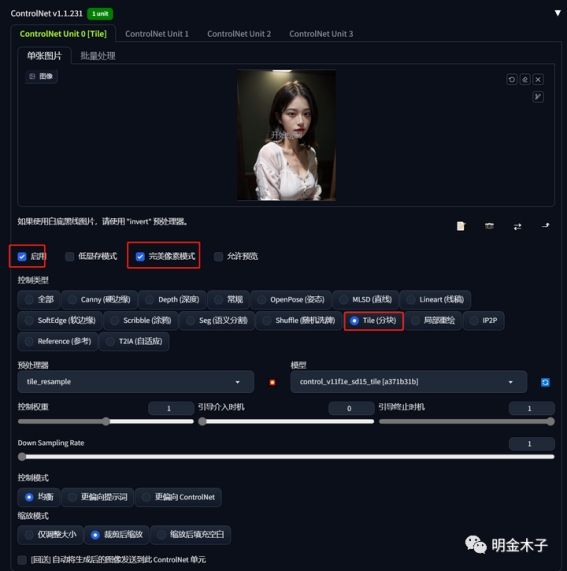

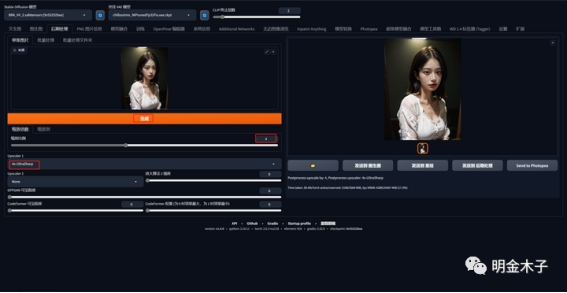

操作步骤二:对初版换脸精修

正向提示词: 1girl, solo, breasts, realistic, cleavage, lips, underwear, medium_breasts, upper_body, looking_at_viewer, black_hair, nose, see-through, bra, photorealistic

(1)将生成的图片发送到图生图

(2)关闭roop插件

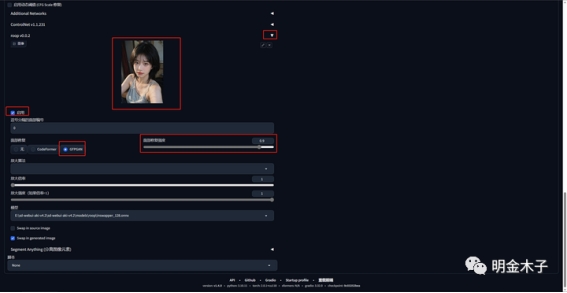

(3)ControlNet v1.1.224:配置详见下图。

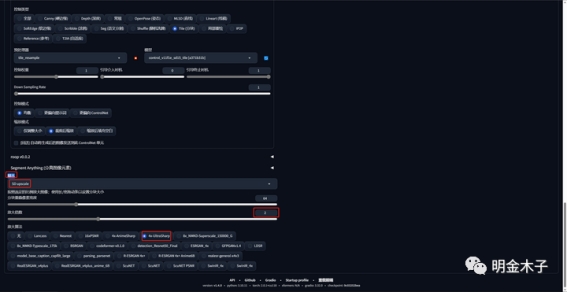

(4)选择脚本并执行生成图片

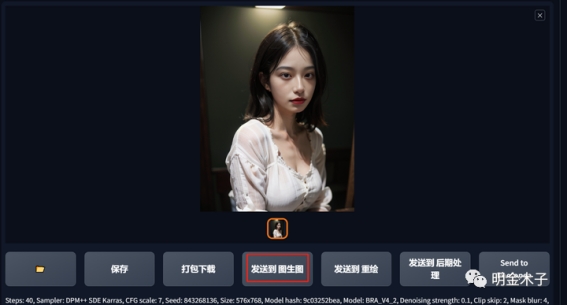

(5)精修后的图片(2K)

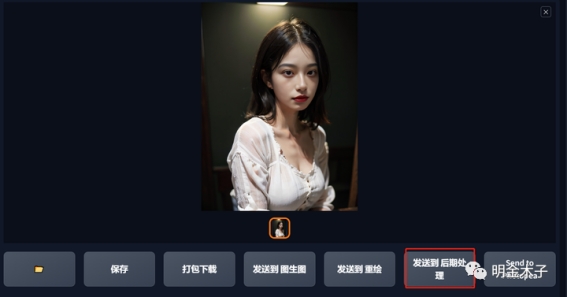

操作步骤三:对精修后的进行高精度处理

(1)发送到后期处理

(2)选择放大算法(4x-UltraSharp)

(3)高精度处理处理后的图片(文件过大上传失败了。。。)

出自:https://mp.weixin.qq.com/s/A3VKJAQZk0TqGWwGASYWfw

本文档由网友提供,仅限参考学习,如有不妥或产生版权问题,请联系我们及时删除。

客服请加微信:skillupvip