本文介绍了阿里巴巴通义实验室研发的AI模型EMO,该模型能够让照片中的人物按照音频内容“张嘴”唱歌、说话,并且口型基本保持一致。EMO在两个月内被产品化并上线通义APP,成为全民免费可用的AI视频模型。该模型降低了人物视频的生成门槛,提升了生成质量,有望在视频制作、影视创作、电商直播等领域得到广泛应用。然而,随着EMO的普及,人们开始担心其可能被滥用,阿里云方面表示将采取措施确保内容安全并保护用户信息安全。文章还指出,AI大模型行业正在快速发展,通义APP有望成为一个包罗万象的工具铺,成为每位用户手中一个随叫随到的超级AI助手。阿里在大模型的C端入口上步伐最快,已经上线了众多免费功能。

又一个国产大模型应用火出圈!

两个月前,阿里巴巴通义实验室公开了一篇能够让照片唱歌说话的生成式AI模型论文,EMO(Emote

Portrait Alive),在海外媒体和社交平台引起热烈反响,被一批科技圈大V轮番转发。4月25日,EMO正式上线通义APP,开放给所有用户免费使用,应用上线瞬间通义APP一度被挤爆,有用户发现自己要排队数小时。其火热程度可见一斑。

下载通义千问APP就可以用了哦。点击频道-全民舞台就可以使用了。

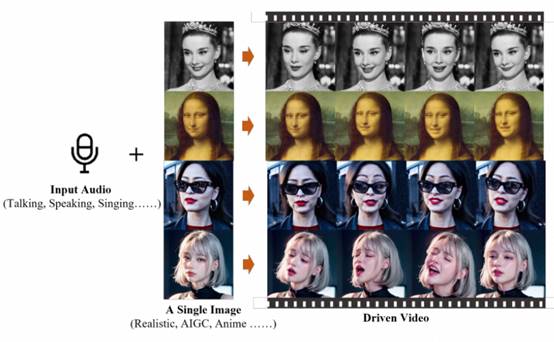

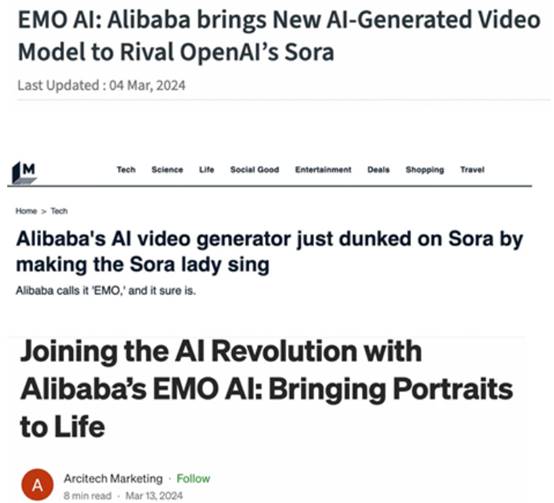

EMO是通义实验室研发的AI模型,于今年2月底公开技术论文,被外媒称之为Sora之后最热门的AI模型之一,在开源社区Github上已经获得了超过6700颗星标。只需要一张人物肖像照片和一段任意时长的音频,EMO就可以让照片中的人物按照音频内容“张嘴”唱歌、说话,且口型基本保持一致,实现自然的面部表情和头部姿态。

短短两个月后,通义实验室已经将EMO产品化。所有用户都可以在通义APP中打开EMO产品页面,在涵盖各类歌曲、热梗和表情包的80多个首批上线模板中任选一个,上传一张肖像照,即可让照片、绘画、“纸片人”、数字人乃至雕像开口说话唱歌,并随时分享或下载保存所生成的视频。

富有表现力的AI视频生成框架

那么,EMO如何实现如此出色的生成效果?

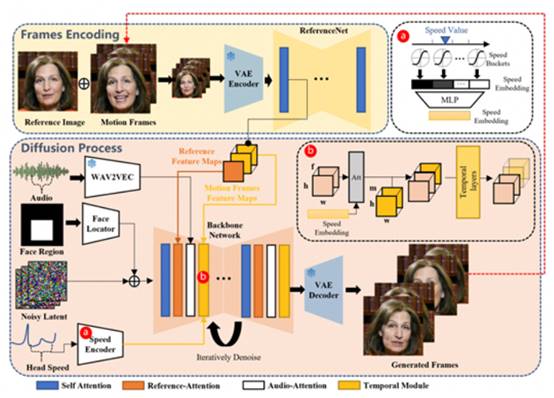

据介绍,与目前市面上的主流视频生成算法不同,EMO的原理是用音频驱动图片的人像,使其做出与音频内容高度匹配的口型和表情。EMO的算法框架分为两步,用ReferenceNet引导去噪,用Backbone(主干网络)主干网络去噪。

在EMO之前,Talking Head领域的工作都需针对人脸、人头或者身体部分做建模或者表征,耗时长且生成质量较低。而EMO首次提出了弱控制的设计,剔除掉针对人脸的显示表征建模,转而采用一些相对较弱的控制条件来引导Diffusion去噪过程。

这就意味着,EMO降低了人物视频的生成门槛,且大幅提升了视频的生成质量,使得这一技术在视频制作、影视创作、电商直播等领域的规模化应用成为可能。

更惊人的是,通过在海量的人物讲话视频上进行训练,EMO模型不仅能够找到音频中具体发音与人像口型的匹配关系,还能发现音频中的语气特征与人物表情的关联性,从而将音频暗含的情绪色彩反映到了人物微表情上。可以说,EMO在训练中慢慢地学习了人类表达情绪的能力,并对其进行了编码。

不过,随着EMO的横空出世,一些人开始担心,EMO模型可能会成为某些别有用心者的犯罪工具。

为防止对口型技术被滥用,阿里云方面表示,通义实验室团队在应用内预置了经过审核的音频模板,暂不开放用户在EMO中自定义音频。用户只可上传照片,且需严格遵守平台协议,使用符合规范的照片来生成视频。其次,平台会对用户生成内容进行算法和人工两道审核,确保内容安全。用户上传的照片仅用于AIGC生成,平台会严格保护用户的信息安全。

同样是出于安全方面的考量,目前,EMO暂不开放API,团队将对安全策略进行充分论证后再进行下一步工作。通义实验室也欢迎社会各界群策群力,提供更好的安全建议,以便在安全可控的前提下推动大模型技术和应用的发展。

阿里:做全民可用的大模型应用

从2022年ChatGPT的诞生,到国内的百模大战,AI大模型热潮已经持续超过一年。如今,大模型已经逐渐走进千行百业,甚至成为全民可用的应用。

今年2月,随着OpenAI放出文生视频模型Sora的展示片段,由于其高水平的演示质量和超出一分钟的生成视频时长,立刻引爆了AI视频行业。在Sora之前,已经出现了Runway、Pika、Stable Video等热门文生视频模型。

不过,Sora直到今天都没有定下面向公众开放的日期,而已经开放的Runway和Pika等模型大多需要按使用次数计费、价格不菲,抑或是需要专业的开发者知识去使用,生成视频时长也不超过16秒。

虽然通义APP上的EMO模型目前只支持有限的模板,但其已经成为全民免费可用的AI视频模型,上手简单、使用方便,还自带供用户进行分享的生态社区。另外,APP上提供的模板中包含了大量网络热梗,有利于所生成短视频的传播和分享,并展现出该模型未来和更多影视IP合作的潜力。

当下,全球AI大模型行业依然进展飞速,各大科技巨头都在积极地卷模型、卷应用。面对迭代速度越快、种类越来越丰富的大模型,时常会让用户产生一种不知从何处下手的感觉。不过,说到底,这些AI模型都是将人类思想与创意具现化的工具,而通义APP有望正在演变成一个包罗万象的工具铺,成为每位用户手中一个随叫随到的超级AI助手。

在大模型的C端入口上,阿里无疑是最激进、步伐最快的科技公司。自今年年初以来,通义APP已经上线了现象级应用“全民舞王”、超长文档解析、AI编码助手、AI会议助手等众多免费功能,成为国内功能最丰富的大模型应用。

本文档由网友提供,仅限参考学习,如有不妥或产生版权问题,请联系我们及时删除。

客服请加微信:skillupvip